Tương lai trung tâm dữ liệu AI: Khi dung lượng lưu trữ và dung lượng AI trở thành thách thức toàn cầu

Trong kỷ nguyên bùng nổ trí tuệ nhân tạo, các trung tâm dữ liệu AI đang phải đối mặt với một vấn đề sống còn: dung lượng lưu trữ và dung lượng AI ngày càng chạm ngưỡng giới hạn. Khi nhu cầu xử lý khối lượng dữ liệu khổng lồ tăng cao, việc mở rộng quy mô không còn đơn thuần là xây dựng thêm các tòa nhà lớn hơn, mà là tìm ra cách kết nối và tối ưu hóa nhiều cơ sở phân tán như một hệ thống thống nhất.

Thách thức khi AI ngày càng phức tạp

Các mô hình AI hiện đại tiêu tốn lượng tài nguyên khổng lồ về tính toán, năng lượng và làm mát. Một trung tâm dữ liệu riêng lẻ khó có thể đáp ứng khi dung lượng AI cần thiết vượt quá khả năng vật lý. Thông thường, các công ty buộc phải xây dựng cơ sở hạ tầng mới, song điều này kéo theo chi phí lớn và phụ thuộc nặng nề vào cơ sở hạ tầng mạng.

Vấn đề nổi cộm chính là độ trễ, “jitter” (dao động hiệu suất), và sự không ổn định trong truyền dữ liệu giữa các trung tâm dữ liệu đặt ở nhiều vị trí khác nhau. Đây chính là nút thắt cổ chai khiến việc phân bổ tính toán AI quy mô lớn trở nên kém hiệu quả.

Công nghệ AI thay đổi cuộc chơi

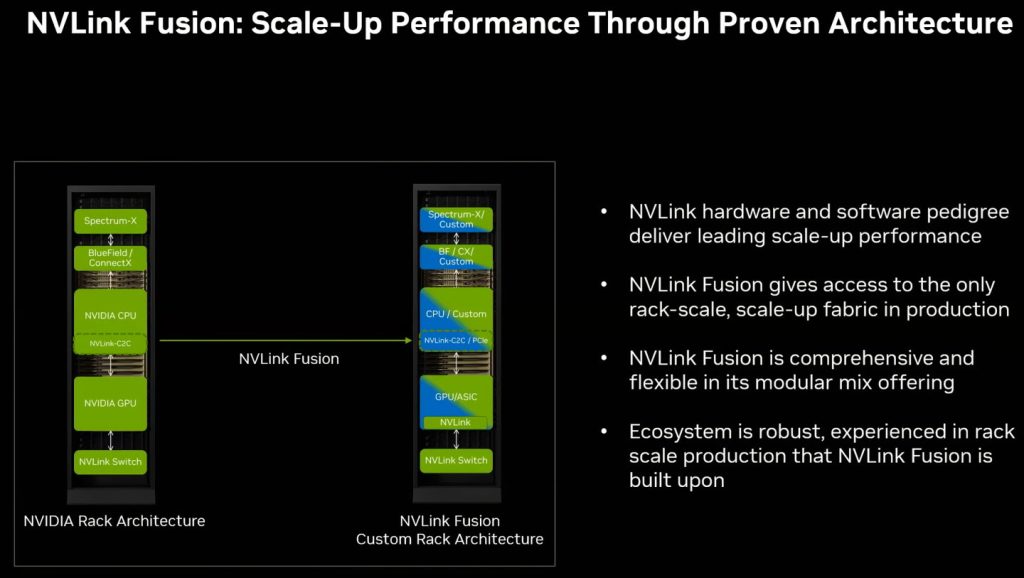

Để giải quyết, công nghệ AI mới như Ethernet Spectrum-XGS của NVIDIA mở ra cách tiếp cận khác biệt. Thay vì chỉ tăng sức mạnh cho từng bộ xử lý hoặc nhồi nhét thêm máy chủ trong một không gian cố định, Spectrum-XGS tập trung vào “mở rộng kết nối quy mô”. Nghĩa là, nhiều trung tâm dữ liệu có thể liên kết với nhau như một “siêu nhà máy AI” thống nhất.

Công nghệ này đem đến các cải tiến nổi bật:

- Thuật toán tự điều chỉnh theo khoảng cách, giúp duy trì hiệu suất khi dữ liệu di chuyển xa.

- Quản lý độ trễ chính xác, đảm bảo phản hồi ổn định.

- Kiểm soát tắc nghẽn dữ liệu thông minh, tối ưu luồng truyền.

- Giám sát từ đầu đến cuối theo thời gian thực để duy trì hiệu quả hoạt động.

Với các tính năng này, Spectrum-XGS được kỳ vọng nâng gấp đôi hiệu suất giao tiếp giữa GPU và các nút tính toán, giúp tối ưu dung lượng AI trên phạm vi rộng.

Ý nghĩa cho ngành công nghiệp AI

Nếu thành công, các doanh nghiệp không còn phải phụ thuộc vào việc xây dựng những trung tâm dữ liệu khổng lồ gây áp lực cho lưới điện và bất động sản. Thay vào đó, họ có thể phân phối hệ thống của mình ra nhiều địa điểm nhỏ hơn mà vẫn đảm bảo hiệu suất. Điều này vừa tiết kiệm chi phí, vừa tăng tính linh hoạt trong mở rộng dung lượng lưu trữ và năng lực AI.

Các công ty như CoreWeave đã nhanh chóng tham gia thử nghiệm, biến công nghệ này thành bước đệm cho một hạ tầng AI quy mô toàn cầu.

Tương lai phía trước

Tuy nhiên, vẫn còn nhiều thách thức về mặt vật lý (tốc độ truyền ánh sáng, chất lượng đường truyền Internet quốc tế), cũng như bài toán đồng bộ dữ liệu và quy định pháp lý xuyên biên giới. Dù vậy, nếu công nghệ mới chứng minh được hiệu quả, ngành công nghiệp có thể bước sang giai đoạn mới, nơi công nghệ AI được triển khai nhanh hơn, mạnh hơn, và chi phí hợp lý hơn.

Tóm lại, việc tối ưu dung lượng lưu trữ và dung lượng AI không chỉ là vấn đề kỹ thuật, mà còn là chìa khóa để hiện thực hóa tầm nhìn về một thế hệ ứng dụng trí tuệ nhân tạo mang tính cách mạng, đặc biệt mình cũng tháy AI của google đang áp dung thử nghiệm cho phần tăng đánh giá google cũng khá ổn, hy vọng những thông tin này giúp các bạn hiểu hơn về AI